发布时间:2026/4/27 14:33:53

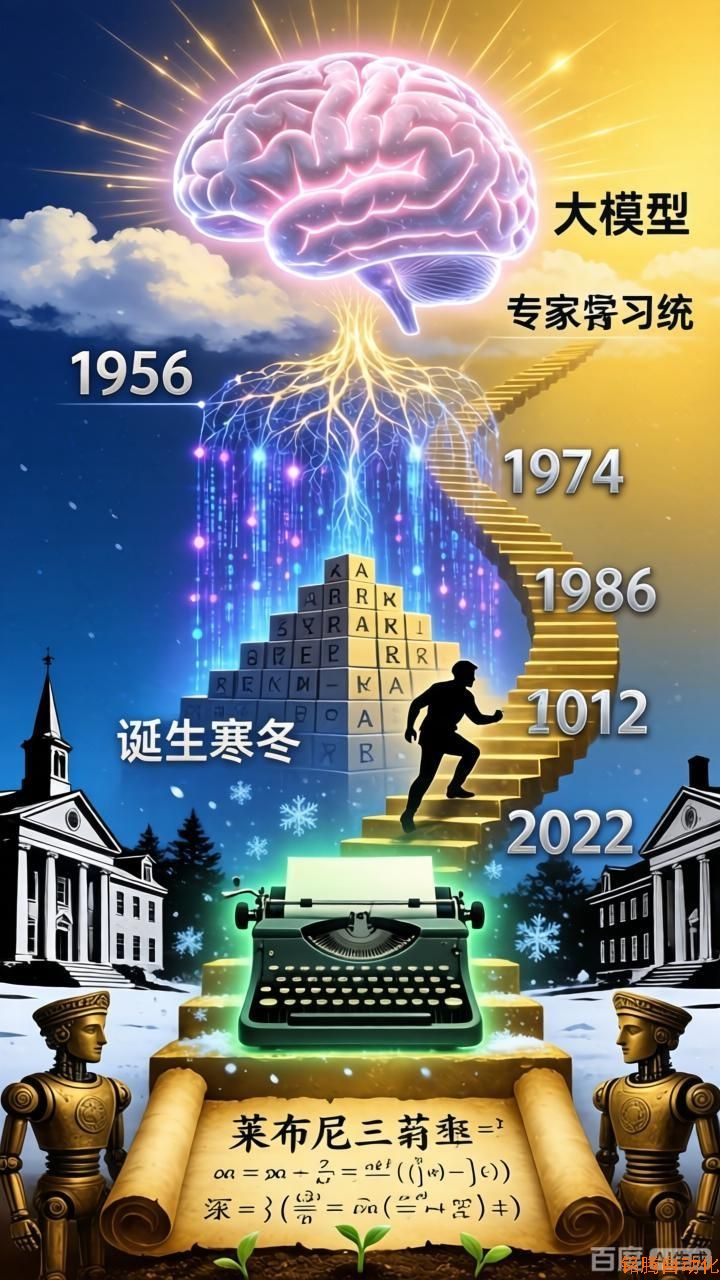

人工智能的构想远早于计算机的出现。古希腊神话中的青铜巨人塔洛斯,犹太传说中黏土塑造的魔像,都寄托着人类创造智能机器的古老梦想。然而真正的理论种子,直到17世纪才播下——莱布尼茨构想着一种“通用符号语言”,让推理可以像数学计算一样精确。他的一句“让我们计算”成为了后世AI的哲学先声。

1956年夏天,美国达特茅斯学院的一场研讨会被公认为人工智能的“出生证明”。麦卡锡、明斯基、香农、纽厄尔和司马贺等一群年轻学者齐聚一堂,正式为这门新兴学科命名——“人工智能”。会议上的乐观情绪弥漫,“用机器模拟人类智能”似乎指日可待。随后十年,第一波AI热潮兴起:逻辑理论家程序证明了数学定理,ELIZA聊天机器人模仿心理治疗师与人对话。

但好景不长。到了1970年代,早期的承诺纷纷落空。学者们发现,真正“智能”所需要的事实常识和语义理解远比想象中复杂。政府资金大幅削减,AI进入了第一个“寒冬”。

1980年代,AI以更务实的方式回归。人们意识到,与其追求通用智能,不如让机器专注于特定领域。专家系统应运而生——将人类专家的规则编码成计算机程序,用于医疗诊断、地质勘探等具体任务。DEC公司的专家系统每年为企业节省数千万美元,AI重新赢得资本青睐。日本第五代计算机项目的启动更掀起了全球竞赛。

然而专家系统同样暴露了致命缺陷:知识难以获取,规则僵硬,无法应对未知情境。1980年代末,随着个人电脑崛起而专用硬件衰落,AI再次陷入低谷。

直到这时,大多数AI系统仍依赖人工编写规则。一个颠覆性的思路早已存在,却长期被冷落——让机器从数据中自己学习。这就是机器学习的思想,其分支神经网络更是命运多舛。早在1958年,罗森布拉特就发明了感知机,但被明斯基的数学证明指出根本局限,神经网络研究因此沉寂了近二十年。

1980年代,反向传播算法的推广让神经网络重新燃起希望,但受限于数据量和算力,效果始终有限。当时的人们不会想到,这个冷板凳上的研究方向,将在未来彻底改变世界。

真正引爆第三次AI浪潮的是三个条件的成熟:海量数据、强大算力、算法突破。

2012年,辛顿团队在ImageNet图像识别大赛中以深度学习模型一举夺冠,错误率比第二名低近一半,整个学术界为之震动。谷歌、微软、百度等科技巨头迅速跟进。2016年,AlphaGo击败围棋世界冠军李世石,标志着AI在“人类智慧的最后堡垒”中胜出。语音助手、人脸识别、推荐算法迅速渗透日常生活。

如果说深度学习让AI学会了“看见”和“听懂”,那么2020年代的大语言模型则让AI学会了“理解”和“生成”。OpenAI的GPT系列模型展现出惊人的能力——写诗、编程、推理、翻译,仿佛一夜间,AI能够以自然语言与人无缝对话。重要的是,这些能力来自同一个基础模型,实现了从“专用AI”向“通用AI”的重要跨越。

与此同时,扩散模型让AI绘画进入大众视野,DALL-E、Midjourney、Stable Diffusion等工具能够根据文字描述创造出令人惊叹的图像。2024年,Sora等视频生成模型进一步扩展了创造的边界,文字到视频的转换开始成为现实。

如今的人工智能正处于一个激动人心的十字路口。AI已经不再是实验室里的玩具,而是深刻地改变着教育、医疗、艺术、制造等各个行业。

然而挑战依然巨大:大模型的算力消耗令人咋舌,幻觉问题尚未根本解决,真正的“理解”和“意识”仍是未解之谜。更紧迫的是,AI的广泛应用带来了就业冲击、隐私泄露、算法偏见等社会问题,对齐研究试图确保AI系统始终遵循人类意图和价值观。

回望六十余年的曲折历程,人工智能几经寒冬与盛夏,每一次低谷都孕育着新的突破。从最初“模拟人类智能”的狂想,到今天“增强人类能力”的务实,AI的发展史本质上是一部人类不断认识自身智慧、并试图在机器中重现它的探索史。而这场探索,才刚刚开始。